Keyword [Weight Transfer] [Mask R-CNN] [Maskx R-CNN]

Hu R, Dollár P, He K, et al. Learning to segment every thing[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2018: 4233-4241.

1. Overview

- 使用监督学习方式训练object instance segmentation任务,要求数据集有segmentation mask的标注。由于mask的标注成本非常高,现有数据集只有较少mask标注,而物体检测box的标注成本相对较低,现有数据集包含大量box标注。

- 因此论文提出一种叫做partially supervised (transfer learning)的训练方法,在包含所有box标注和少量mask标注的数据集上训练能够分割所有box标注对象的instance segmentation模型。对maks预测和box预测解耦的Mask R-CNN结构非常适合用于这种训练方法,论文称网络结果为Maskx R-CNN。

- 论文在COCO和Visual Genome数据集上进行实验,训练出能够检测3000种对象类别的instance segmentation模型。

1.1. 思想

- 在视觉语义空间中,邻近的embedding向量在appearance或semantic上相近。可将box head(最后一层)权重参数和mask head(最后一层)权重参数看作embedding向量。同类别的两个向量在appearance上相似,因此可利用transfer从box head embedding向量学习出mask head embedding向量。

- 利用weight transfer function基于box权重预测mask权重,weight transfer function通过少量mask标注数据进行学习。由于box权重是针对所有box标注对象而言的,因此transfer后的mask权重也能够针对所有box标注对象, 从而能够预测数据集中mask标注对象以外的对象。换而言之,将category specific信息从box detectors迁移到instance mask predictors.

1.2. 数据集

- COCO. 为了模拟partially supervised instance segmentation, 将数据集分为两部分:使用box标注和mask标注、只使用box标注。

- Visual Genome. 规模较大,只有box标注信息。

2. 细节

2.1. 训练数据划分

- C=A∪B

- C. 数据集中所有对象类别

- A. 含有mask标注的对象类别

- B. 只有box标注的对象类别

(已知mask标注,可以很容易得到box标注)

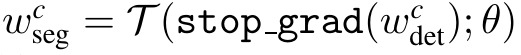

2.2. Weight Transfer Function

- w_{det}. box head最后一层中的权重,可看作appearance-based visual embedding

- w_{seg}. mask head最后一层中的权重

- Θ. 学习的参数,class-agnostic

w_{det}的三种类型

- w_{cls}

- w_{box}

- cat(w_{cls}, w_{box})

2.3. 训练

使用A∪B训练box head,使用A训练mask head和τ. 训练方式可分为两种

- State-wise Training

- 第一阶段只使用A∪B中的box标注训练模型。第二阶段固定conv和box head,使用A中的mask标注训练mask head和τ.

- End-to-end Joint Training(Mask R-CNN论文中表明multi-stask训练优于分别训练每个任务)

- Box loss和mask loss都直接回传,但在transfer分支上的mask loss回传至τ后停止(由于只有A的mask loss回传至w_{deg},不存在B的mask loss,为了保持w_{det}在A和B之间的一致性)。

2.4. Baseline

Mask R-CNN with class-agnostic FCN mask head.

2.5. 扩展:融合FCN+MLP Mask Head

- 两种mask head互补

- FCN. capture detail

- MLP. capture gist

- 对baseline的FCN和论文transfer模型的FCN进行MLP融合来提高效果

3. Experiments on COCO

- 为了模拟partially supervised训练,将COCO中80个类别分为A(20, 类别包含为VOC数据集中,voc)和B(60, non-voc)

- Oracle Model. 同时利用A和B中的mask标注进行训练Mask R-CNN

3.1. 实验结果

3.2. Ablation Experiments

τ的输入

MLP融合

训练方式

4. Experiments on Visual Genome

使用VG数据集的box标注,COCO数据集的mask标注,由于VG没有mask标注,无法计算AP,因为论文直接可视化结果